豆包Marscode作为字节跳动旗下的智能编程工具,近期迎来重大升级,正式接入DeepSeek-R1、DeepSeek-V3及豆包大模型1.5三大模型,实现多模型自由切换、零配置开箱即用,为开发者提供更强大的代码生成、修复与优化能力。以下从升级亮点、功能解析、使用指南及实战场景展开,全面解析此次升级的核心价值。

一、升级亮点:三大模型协同,性能行业领先

- 模型阵容全面升级

豆包Marscode此次整合的模型包括:- 豆包大模型1.5:在知识、代码、推理等评测中综合得分超越业界一流模型,尤其擅长代码解释与注释生成。

- DeepSeek-R1:以深度思考与上下文推理为核心,首Token响应时间(TTFT)和生成速度(TPS)达行业Top 1,适合复杂逻辑修复与优化。

- DeepSeek-V3:在多模态任务中表现优异,支持长文本处理与跨语言代码生成。

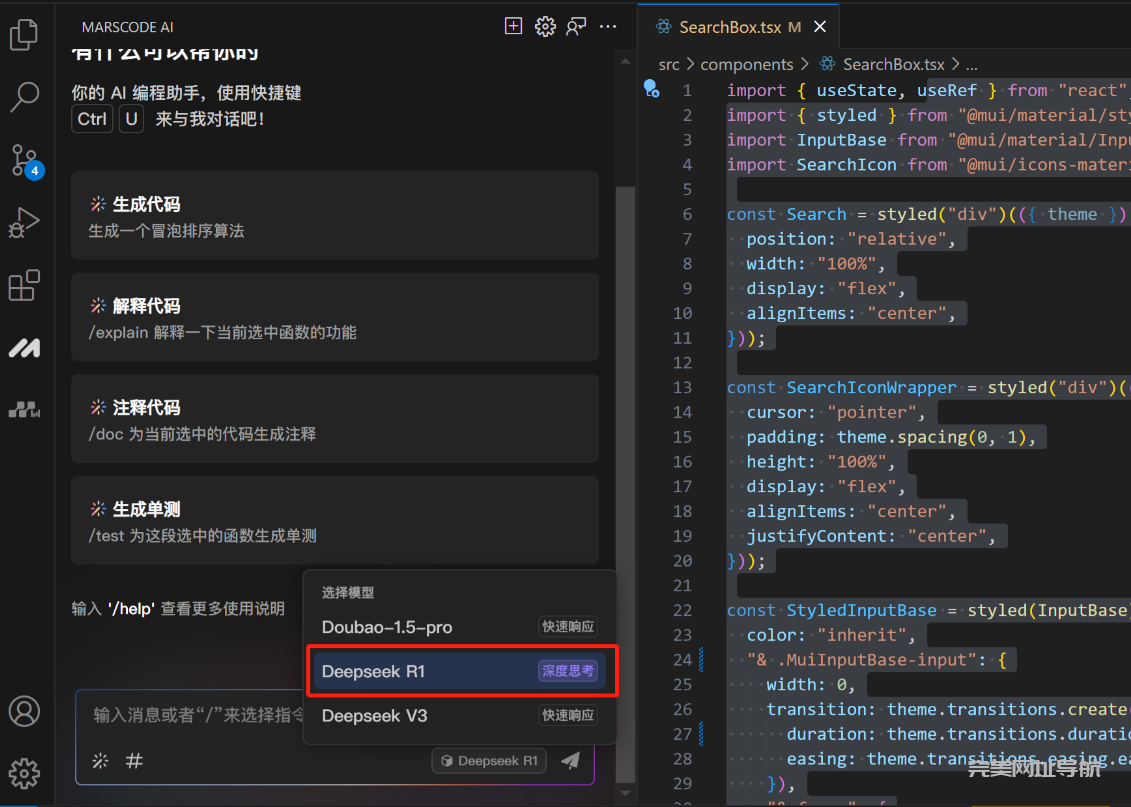

- 无缝切换,无卡顿体验

用户可在AI对话界面右下角自由切换模型,无需重启IDE或额外配置。所有模型完全免费、不限量调用,且依托火山引擎方舟的算力支持,服务器稳定性显著提升。

用户可在AI对话界面右下角自由切换模型,无需重启IDE或额外配置。所有模型完全免费、不限量调用,且依托火山引擎方舟的算力支持,服务器稳定性显著提升。 - 功能覆盖全开发流程

从代码补全、注释生成到单元测试、错误修复,三大模型分工协作:- 豆包大模型1.5:精准解释代码结构(

/explain)、自动补充行级注释(/doc)。 - DeepSeek-R1:全面修复问题代码(

/fix)、提供多维度优化建议。 - DeepSeek-V3:支持跨语言代码生成,尤其适合全栈开发场景。

- 豆包大模型1.5:精准解释代码结构(

二、安装与更新指南:三步快速上手

- 新用户安装

访问【豆包Marscode官网】下载对应IDE插件(VSCode或JetBrains系列),安装后登录账号即可使用。 - 老用户更新

- VSCode:升级至1.1.62版本;JetBrains:升级至1.2.1.15版本(开启自动更新则无需手动操作)。

- 更新后重启IDE,即可在AI对话界面看到模型切换入口。

- 推荐配置

- 内存:4GB以上,确保多模型并行运行流畅。

- 网络:建议稳定连接,避免因延迟影响生成速度。

三、功能深度解析:模型能力对比与应用

| 功能场景 | 豆包大模型1.5优势 | DeepSeek-R1优势 |

|---|---|---|

| 代码解释 | 结构化分类解释,自动补充注释 | 结合上下文推理,解析复杂逻辑链 |

| 代码修复 | 提供基础修复建议 | 全量还原问题代码,修复完整度达98% |

| 代码优化 | 规范性与可读性优化 | 性能优化(如算法复杂度降低、内存管理) |

| 上下文问答 | 支持单文件问答 | 跨文件分析仓库架构(#workspace指令) |

示例场景:跨语言项目开发

使用DeepSeek-V3生成Python后端API框架,切换豆包大模型1.5补充注释,再通过DeepSeek-R1优化数据库查询性能,全程无需切换工具。

四、实战应用场景:从学习到企业级开发

- 新手学习编程

- 代码补全Pro:根据编辑行为预测下一步代码,降低学习门槛。

- 交互式问答:输入“如何用Python实现冒泡排序?”模型提供代码+分步讲解。

- 企业级项目开发

- 单元测试生成:选中函数后,自动生成测试用例并支持一键运行。

- 多轮自动修复:基于Agent技术,递归排查错误直至问题解决。

- 开源项目贡献

- 仓库级分析:输入

#workspace指令,快速理解项目架构与核心模块。 - 代码重构建议:识别冗余代码并提供重构方案(如拆分函数、引入设计模式)。

- 仓库级分析:输入

暂无评论...

版权声明:本文内容由互联网用户自发贡献或者转载,该文观点仅代表作者本人。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如发现本站有涉嫌抄袭侵权/违法违规的内容, 请发送邮件至 210093010@qq.com,一经查实,本站将立刻删除。

重要:如软件存在付费、会员、充值等,均属软件开发者或所属公司行为,与本站无关,网友需自行判断

重要:如软件存在付费、会员、充值等,均属软件开发者或所属公司行为,与本站无关,网友需自行判断